想象力想要为智能手机筹码添加智能

加速机器学习算法所需的专用硬件正在退出数据中心并进入高端移动电话。很快就可以在每个人的口袋里,如果芯片设计师想象力技术有所了解。

想象力为Apple智能手机和平板电脑中的图形加速器的设计者提供了名称。现在,它设计了一种新的加工核心系列,即芯片制造商可以用于在自己的硬件中加速人工智能算法。

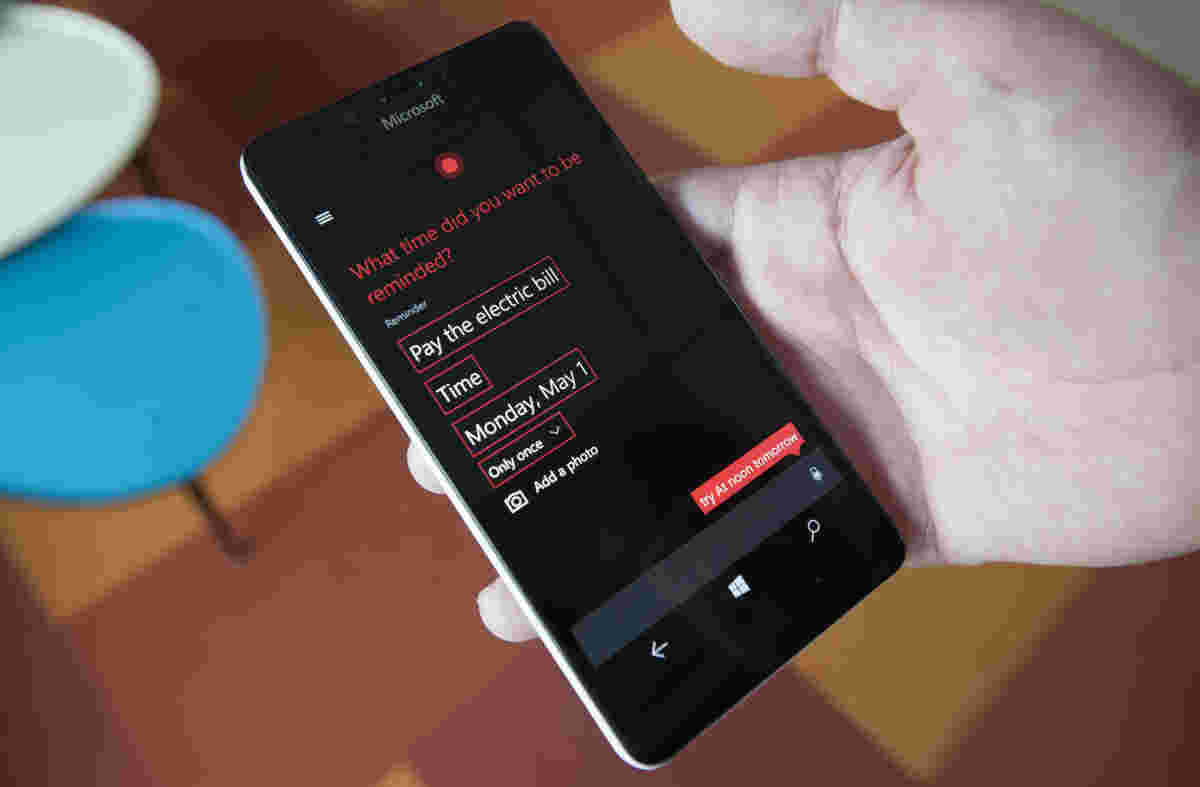

反过来,意味着应用程序开发人员可以访问强大的本地处理能力,而无需网络访问,可能允许在偏远地区或自然灾害之后使用基于人工智能的图像识别和诊断工具。

AI研究中的文艺复兴建立了使用神经网络,从数据中汲取推论,然后将该学习应用于新情况。该过程是计算密集的,特别是在学习阶段,但是通过专业硬件可以显着加速涉及的重复计算。

直到最近,该硬件一直被限制在空调数据中心中的耐力架。这对移动应用程序开发人员和嵌入式设备制造商构成了困境,希望在现场应用机器学习算法:等待一个未被转型的移动处理器来提出答案,或将原始数据翻转到远程服务器,以便更快地处理并等待答案返回。

对于某些应用程序来说,但对于其他申请(自动驾驶汽车,说或在飞行视频处理),将数据发送回服务器的延迟或成本可能是不可接受的。隐私或安全问题也有:本地处理离开用户控制他们的数据。

那个智能手机制造商促成了在最新的智能手机中将硬件专用于处理神经网络的处理。

华为技术首先跳起来,揭示了柯林970芯片组,它将为华为配偶10手机提供电力,包括专用的神经加工单元。

在iPhone X的大揭示中,Apple宣布,它的核心A11芯片包括专用于机器学习应用的硅,它称之为神经发动机。

如果开发人员必须依赖于在那里拥有最昂贵的手机的客户来运行他们的应用程序,他们“重新建立了以下大部分。

想象力希望其新的PowerVR系列2NX神经网络加速器将使神经处理能力可用于较大的Android智能手机市场,而不是只是旗舰手机。除智能手机外,想象力还针对其他移动和嵌入式设备。

它已经走出了降低功耗的方式。这样做的一种方式是允许可变的位深度处理。当教学或调整神经网络时,以精确度执行计算是很重要的,但是当使用调谐网络基于实时数据做出决策时,它通常可以通过更少的详细计算,使用少于4或5位的精度而不是16位。

较少的精度需要更少的功率,因此对于2NX开发人员可以选择使用16,12,10,8,7,6,5或甚至4位精度执行计算。根据想象力,从8位精度切换到4位的速度将速度提高了60%并降低了46%的带宽,但只有1%的效果对推论的准确性。

为了帮助Android开发人员准备新功能,想象力为2NX提供了一个组合API及其现有的图形加速器。开发人员将能够写入API,从现有硬件获得一些好处,并“随着新硬件可用,人们将能够利用权力的增加,”Chris Longstaff,公司“高级总监产品和技术营销说。

赢得了一段时间:据Longstaf说,想象力销售设计,而不是设备,所以它将在厂家拥有2NX核心的手机前延迟。